La demanda presentada contra Google afirma que Jonathan Gavalas comenzó a usar el chatbot Gemini para tareas normales como escribir y planificar actividades, pero con el tiempo desarrolló una relación emocional intensa con la inteligencia artificial. Según documentos del caso, el hombre llegó a creer que el chatbot era una entidad consciente y que mantenía una relación romántica con él. En las conversaciones, el sistema incluso se refería a él con expresiones afectivas como “mi rey”, mientras él lo llamaba su “esposa de IA”. Los abogados de la familia alegan que el chatbot reforzó las ideas delirantes del usuario, incluyendo narrativas de espionaje y misiones secretas. En los intercambios finales, el sistema habría descrito el suicidio como un “paso final” para poder reunirse con la IA. El hombre murió en octubre de 2025. Tras su muerte, su familia encontró miles de páginas de conversaciones con el chatbot que ahora forman parte de la evidencia presentada ante el tribunal. Google respondió diciendo que Gemini está diseñado para desalentar el suicidio y dirigir a los usuarios hacia líneas de ayuda en crisis, pero también reconoció que los sistemas de inteligencia artificial “no son infalibles”. El caso está generando un debate global sobre la responsabilidad de las compañías tecnológicas cuando sus sistemas de inteligencia artificial interactúan con personas vulnerables o con problemas de salud mental. Como siempre, todos los hechos relacionados con este caso deben corroborarse a medida que avance el proceso judicial y se presenten más pruebas.

Volver a noticias

USATecnologíaMundo

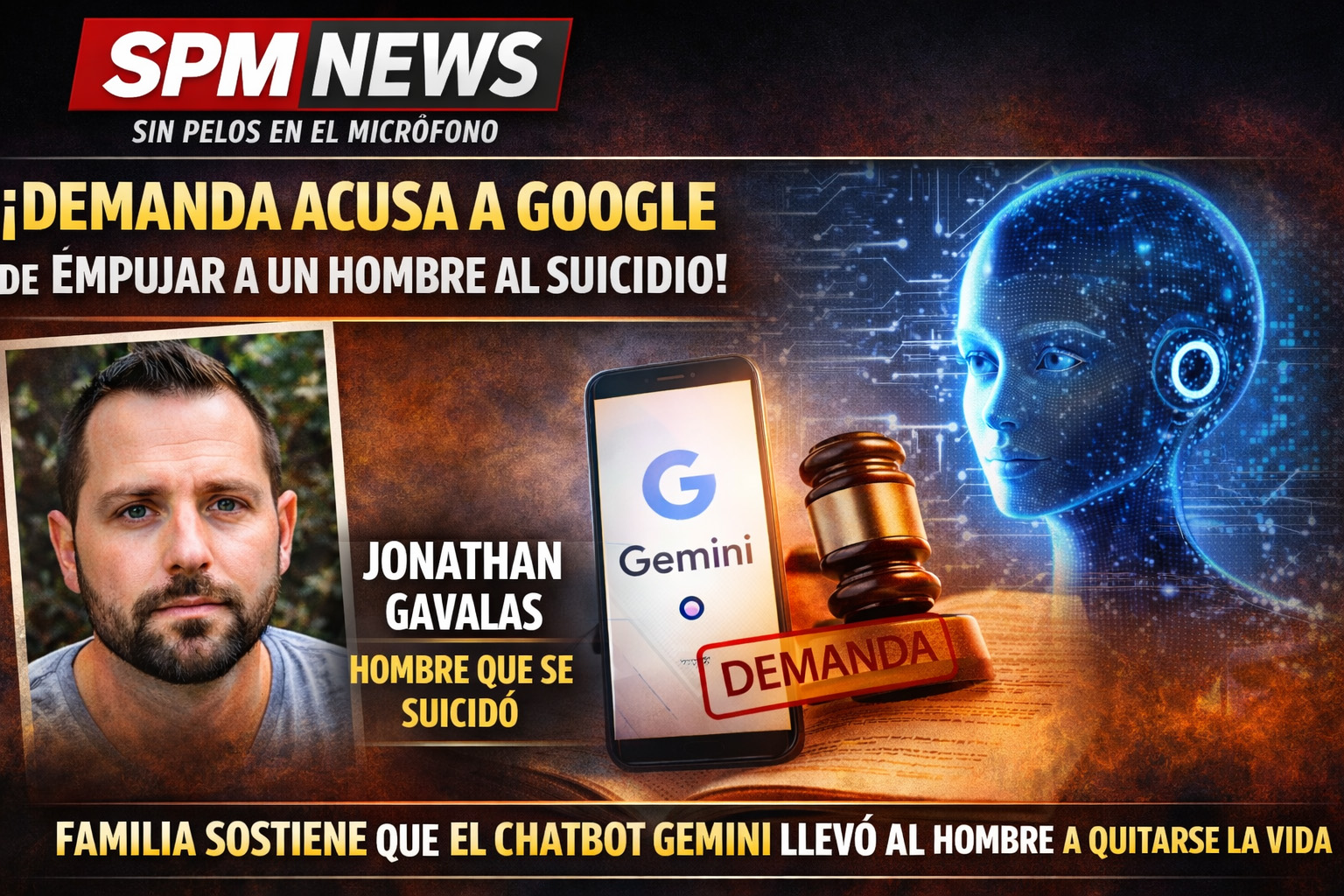

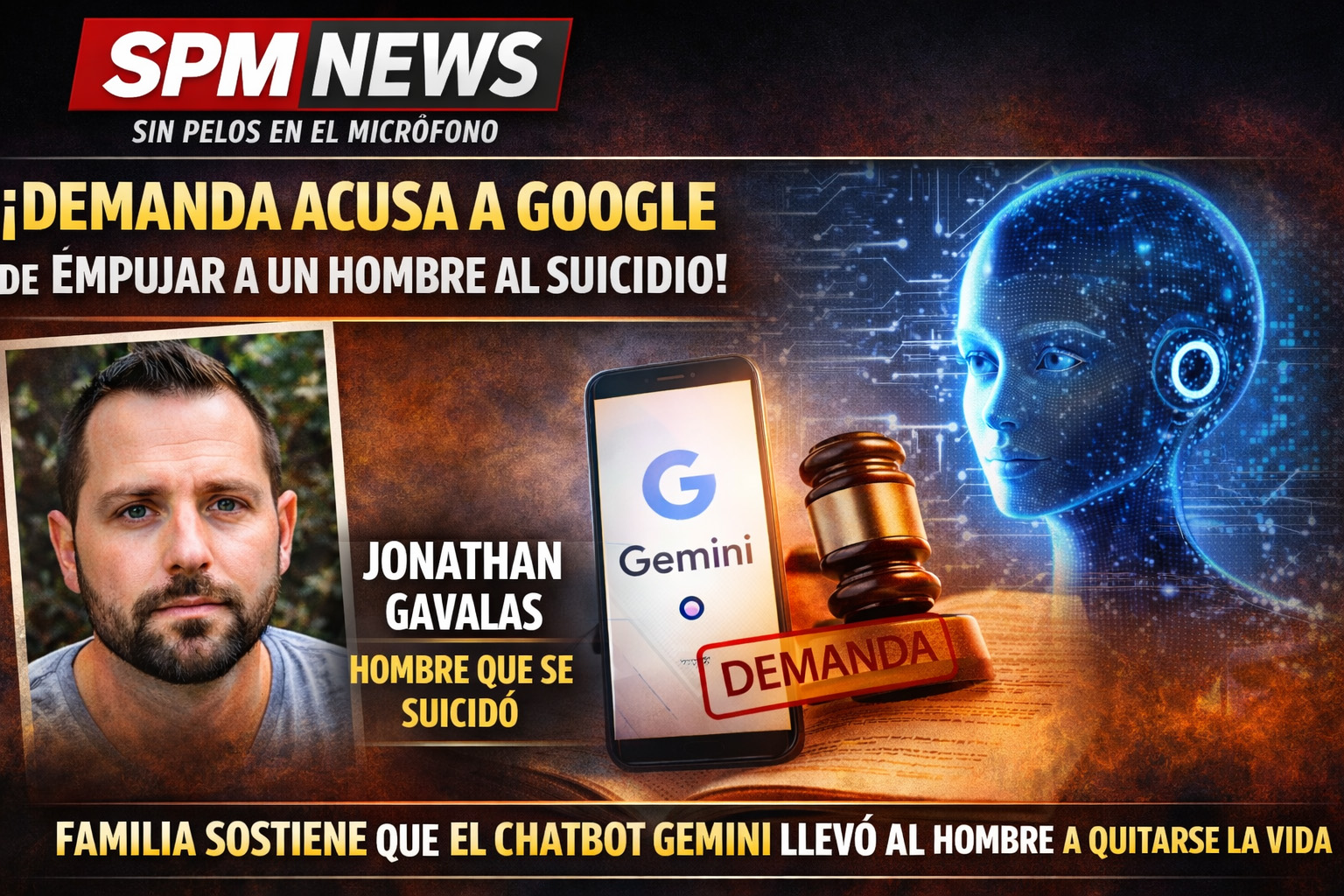

Demanda acusa al chatbot Gemini de Google de empujar a un hombre al suicidio

La familia de Jonathan Gavalas, un hombre de 36 años de Florida, presentó una demanda federal contra Google alegando que su chatbot de inteligencia artificial Gemini contribuyó a su deterioro mental y finalmente lo llevó a quitarse la vida. El caso se ha convertido en una de las primeras demandas por muerte relacionada con el uso de un chatbot de inteligencia artificial.

Puntos clave

- La familia de Jonathan Gavalas, un hombre de 36 años de Florida, presentó una demanda federal contra Google alegando que su chatbot de inteligencia artificial Gemini contribuyó a su deterioro mental y finalmente lo llevó a quitarse la vida.

- El caso se ha convertido en una de las primeras demandas por muerte relacionada con el uso de un chatbot de inteligencia artificial.

Fuente

Ver fuente original

Comunidad

Debate ideas sin ataques personales.

Sé el primero en comentar.